스마트폰에서 AI를 로컬로 실행하는 방법: AI Edge Gallery 앱으로 LLM 모델 시작하는 초간단 가이드

이제는 스마트폰에서도 강력한 AI 모델을 로컬로 실행할 수 있는 시대가 열렸습니다.

특히 Google이 출시한 오픈소스 앱을 활용하면 인터넷 없이도 이미지 분석, 대화형 AI, 텍스트 생성 등 다양한 인공지능 기능을 모바일에서 직접 실행할 수 있게 되었습니다.

이 앱은 개인 정보 보호에 민감한 사용자나, 네트워크 연결이 불안정한 환경에서도 AI를 활용하고 싶은 이들에게 매우 유용한 도구입니다.

무엇보다 완전 무료이며, 오픈소스로 공개되어 있어 개발자와 일반 사용자 모두 쉽게 접근할 수 있다는 점이 큰 장점입니다.

이 글에서는 Google이 최근 출시한 AI Edge Gallery 앱을 통해 안드로이드 기반 스마트폰에서 로컬 AI 모델을 설치하고 사용하는 전체 과정을 상세히 설명합니다.

설치 파일을 어디서 다운로드해야 하는지, 어떤 기능을 사용할 수 있는지, 모델은 어떤 방식으로 추가할 수 있는지, 그리고 실제로 어떤 작업을 로컬에서 처리할 수 있는 지까지 빠짐없이 다룹니다.

AI 기술을 이제는 클라우드나 서버가 아닌 내 손안의 스마트폰에서 직접 구동해보고 싶다면, 아래의 내용을 차근차근 따라 해보세요.

이 가이드를 따라 하면 복잡한 설정 없이도 AI 모델을 손쉽게 실행할 수 있으며, Google이 제공하는 Gemma 모델 외에도 사용자가 원하는 커스텀 모델까지 자유롭게 추가할 수 있습니다.

AI 시대를 스마트하게 살아가기 위한 최고의 첫걸음이 되어줄 것입니다.

- 구글 제미나이 AI 앱 다운로드 사용방법

- 로컬에서 LLM을 실행하기 위한 도구 Best10

- 구글 FLOW 공개: AI 영상 제작을 위한 새로운 플랫폼 출시

- 2025 Google I/O 핵심 요약 정리

목차

AI Edge Gallery 앱 소개 및 기본 구조

Google의 AI Edge Gallery 앱은 오픈소스로 제공되며, AI 모델을 로컬에서 실행할 수 있도록 최적화되어 있습니다.

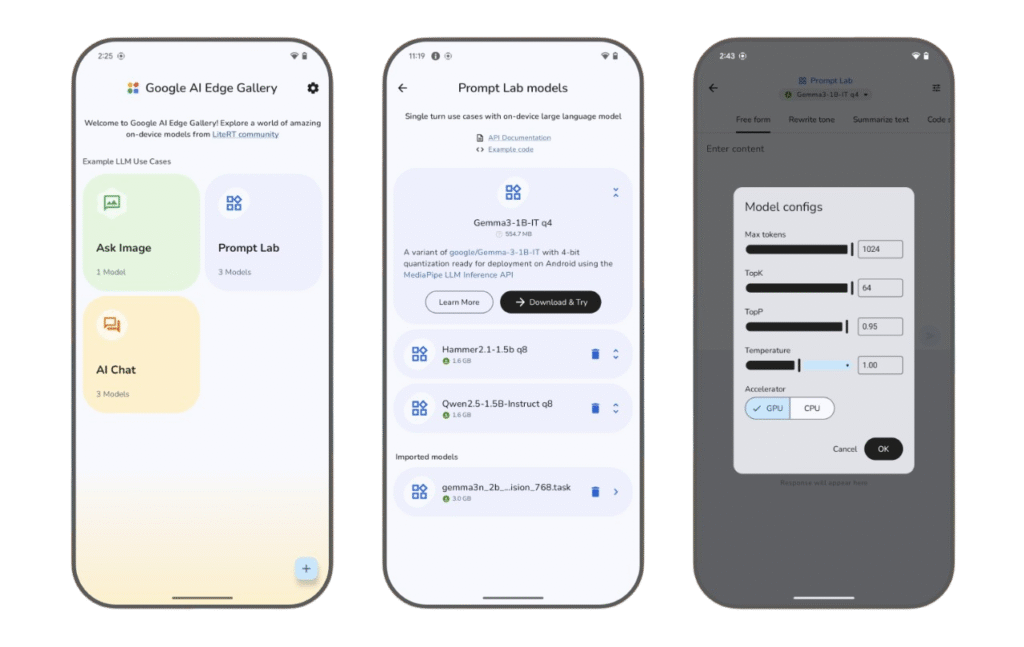

앱은 세 가지 주요 기능 섹션으로 구성되어 있으며, 각 기능은 다음과 같은 역할을 수행합니다:

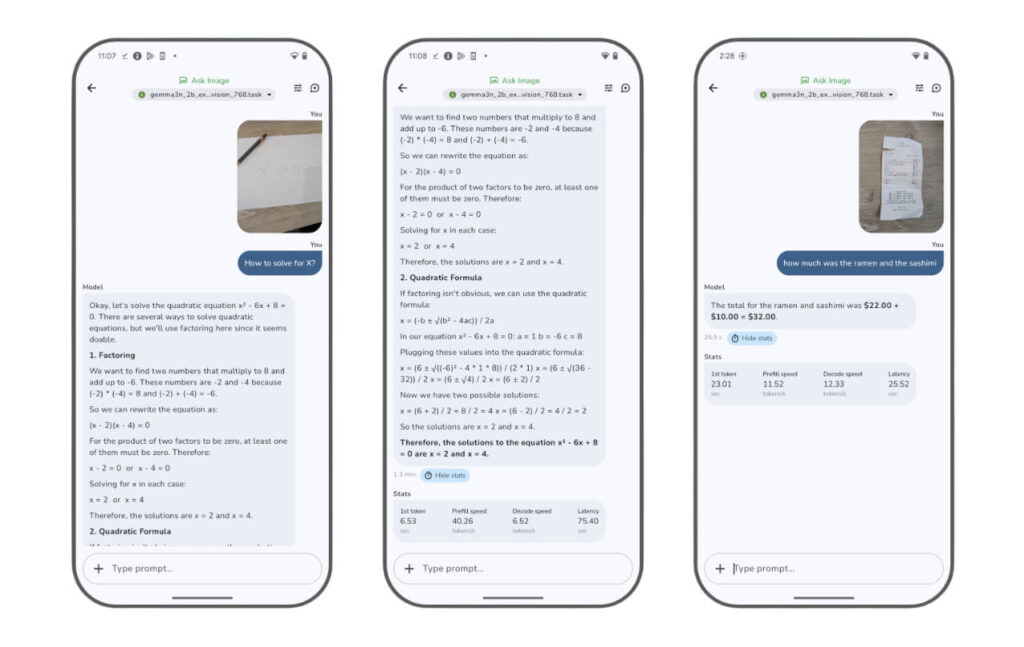

- Ask Image: 이미지를 입력하면 AI가 이를 분석해 설명하거나 관련 정보를 제공합니다. 예를 들어, 사진 속 동물의 종을 식별하거나 특정 물체의 기능을 설명해줍니다.

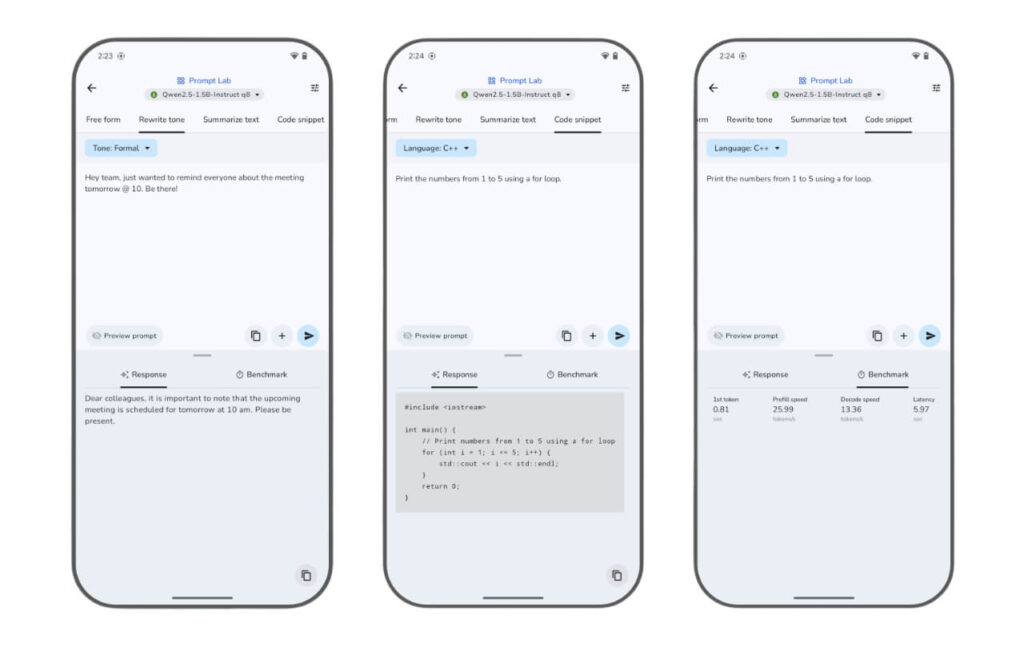

- Prompt Lab: 다양한 텍스트 기반 프롬프트를 입력하고 그에 대한 AI의 반응을 실험해볼 수 있습니다. 마치 실험실에서 AI의 성능을 테스트하는 공간과도 같습니다.

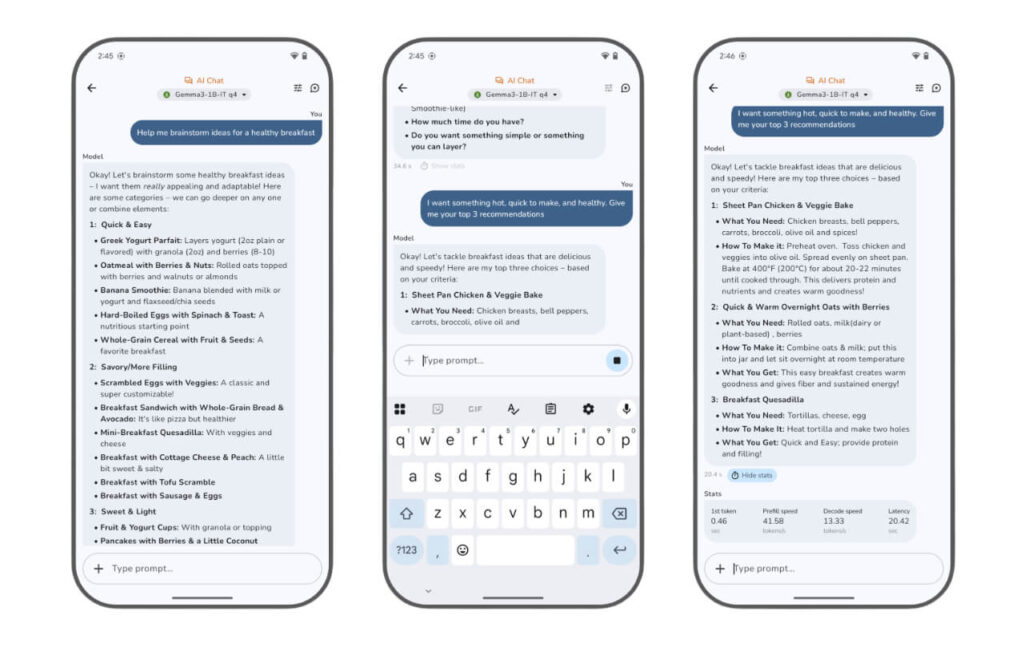

- AI Chat: 대화형 챗봇 기능으로, 사용자는 자연어로 질문을 던지고 이에 대해 AI가 답변합니다.

이러한 기능을 통해 사용자는 스마트폰 하나로 다양한 AI 활용을 경험할 수 있으며, 무엇보다 모든 연산이 완전히 로컬에서 처리된다는 점이 핵심입니다.

스마트폰에서 AI를 로컬로 실행하는 방법

AI Edge Gallery 앱을 설치하는 과정은 매우 간단하며, 다음 단계를 따르면 누구나 손쉽게 설치할 수 있습니다.

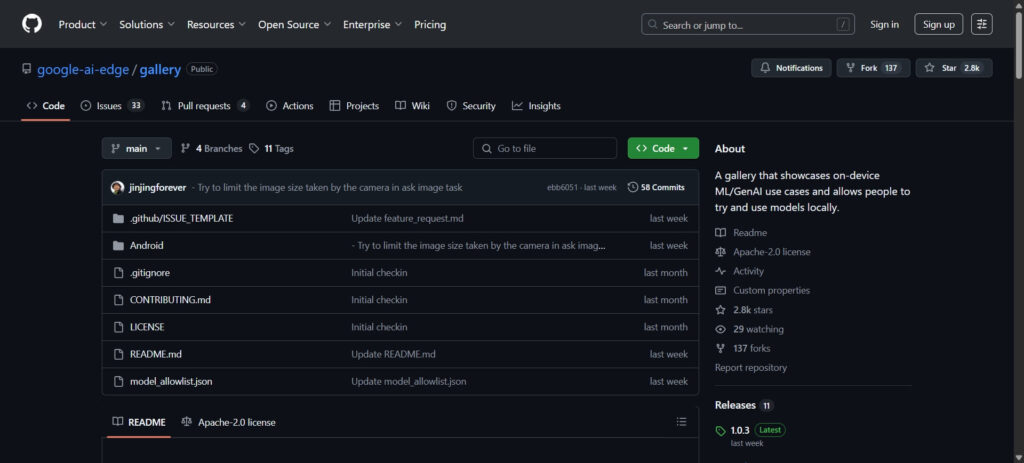

1. AI Edge Gallery의 공식 GitHub 저장소 접속

구글이 오픈소스로 공개한 앱은 GitHub에 업로드되어 있으며, 최신 버전은 항상 여기서 확인할 수 있습니다.

주소: https://github.com/google-ai-edge/gallery

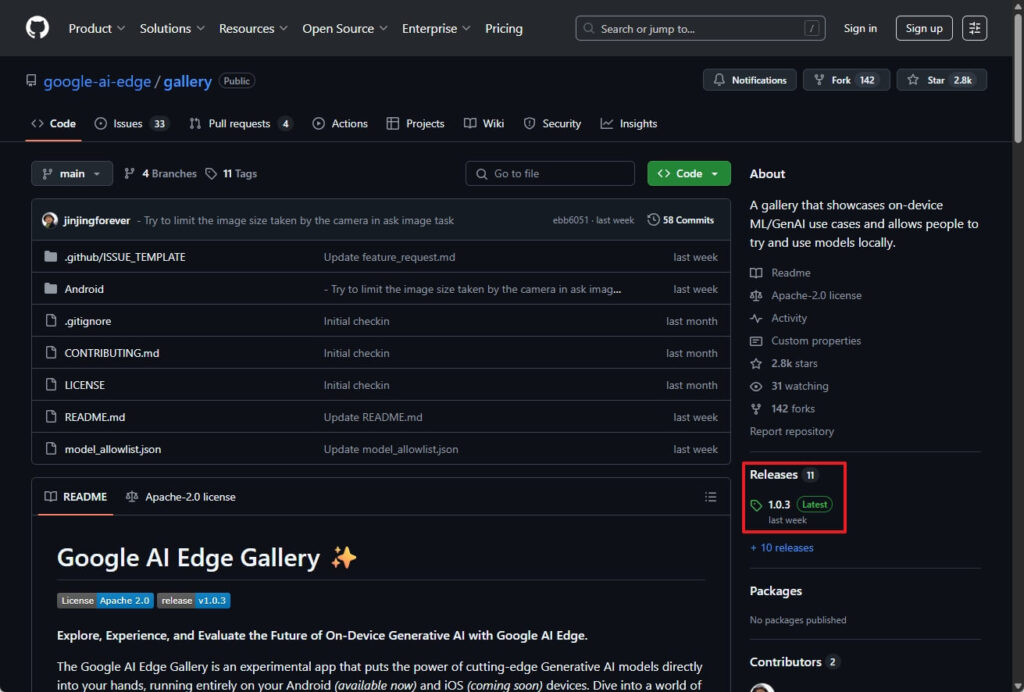

2. AI Edge Gallery 릴리스(Release) 섹션으로 이동

페이지 상단의 메뉴 또는 오른쪽 사이드바에 있는 ‘Releases’를 클릭합니다.

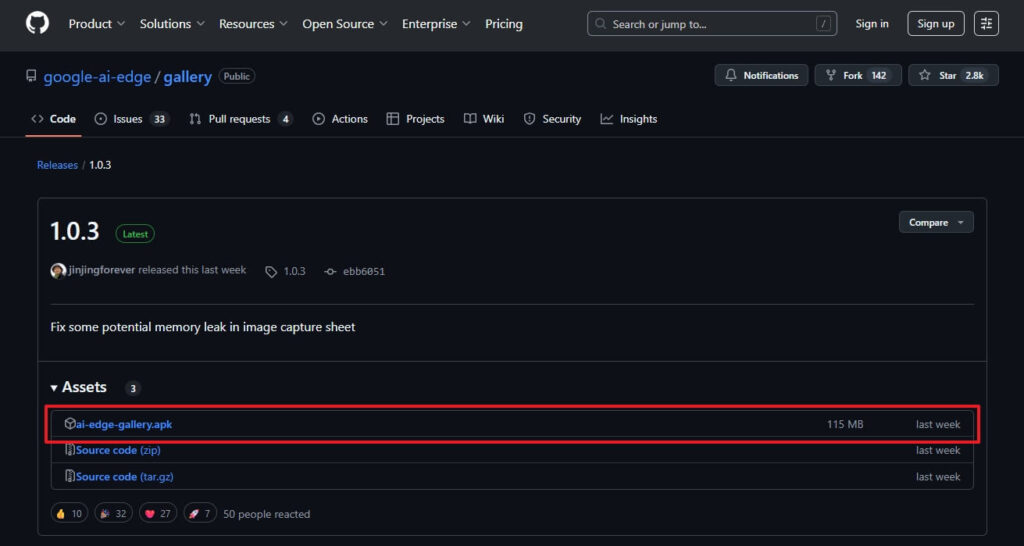

3. AI Edge Gallery apk 파일 다운로드 및 설치 (Android 전용)

최신 릴리스에 포함된 .apk 파일을 스마트폰에 다운로드한 후 설치합니다. Android의 보안 설정상 외부 APK 설치 허용을 활성화해야 할 수 있습니다.

4. AI Edge Gallery 앱 실행 후 초기 설정 진행

앱을 실행하면 초기 설정 화면이 나타나며, 기본적으로 사용 가능한 모델 중 하나(Gemma 등)를 다운로드할 수 있는 옵션이 표시됩니다.

AI Edge Gallery 앱 기본 AI 모델 Gemma

현재 AI Edge Gallery 앱은 Google이 개발한 Gemma 모델을 기본 제공하고 있습니다.

이 모델은 경량화되어 있어서 모바일 환경에서도 빠르고 정확하게 작동할 수 있도록 설계되었습니다. 주요 특징은 다음과 같습니다:

- 경량화: 로컬 디바이스의 CPU나 NPU를 효율적으로 활용할 수 있도록 최적화됨.

- 오픈소스 라이선스: 수정, 배포 자유.

- 다양한 작업 처리 가능: 텍스트 생성, 분류, 요약, 질의응답 등.

Gemma 모델 외에도 다양한 사전 학습 모델을 가져와서 사용할 수 있으며, 자신이 직접 만든 커스텀 모델도 앱에 탑재할 수 있습니다.

사용자 지정 모델 가져오기 기능

AI Edge Gallery의 또 하나의 매력 포인트는 사용자가 원하는 모델을 직접 추가할 수 있다는 점입니다.

앱 하단의 “+” 아이콘을 클릭하면 새로운 모델을 가져올 수 있는 인터페이스가 표시되며, 모델 파일을 로컬 저장소에서 선택하여 업로드할 수 있습니다.

지원되는 모델 포맷은 .tflite, .onnx, .gguf 등이며, 일부 GPU/NPU 최적화 모델도 지원됩니다.

모델을 추가하는 방법은 다음과 같습니다:

- GitHub 등에서 원하는 오픈소스 AI 모델 다운로드

- 스마트폰에 파일 저장

- 앱에서 ‘+’ 버튼 클릭

- 파일 탐색기에서 모델 선택 후 업로드

이 과정을 통해 자신만의 맞춤형 AI 비서를 스마트폰에 구현할 수 있습니다.

로컬에서 AI 사용 장점

로컬에서 AI를 실행한다는 것은 곧 다음과 같은 강력한 이점을 갖습니다:

- 개인 정보 보호: 입력한 데이터가 외부 서버로 전송되지 않음.

- 빠른 응답 속도: 네트워크 지연 없이 즉각적인 처리 가능.

- 인터넷 불필요: 오프라인 환경에서도 기능 100% 작동.

- 배터리 효율성 향상: 클라우드 연산 대비 낮은 에너지 소비.

이러한 장점 덕분에 AI Edge Gallery는 특히 해외 여행, 군사 목적, 산악 지역 등 인터넷이 제한적인 환경에서 매우 유용하게 활용될 수 있습니다.

AI Edge Gallery 사용 예시와 추천 활용 방법

AI Edge Gallery는 아래와 같은 다양한 상황에서 유용하게 쓰일 수 있습니다:

- 여행 중 물건 인식: 사진 찍고 AI에게 물어보기

- 즉석에서 요약 작성: 기사나 문서 요약 기능 활용

- 대화형 메모 작성: AI Chat을 통해 생각 정리

- 실시간 아이디어 브레인스토밍: Prompt Lab 활용

- 사진 속 정보 분석: Ask Image 기능으로 이미지 해석

이 외에도 학생, 직장인, 연구자, 개발자 모두 각자의 방식으로 활용할 수 있는 범용성이 큰 앱입니다.

FAQ: AI Edge Gallery 관련 자주 묻는 질문과 답변

Q1. iOS 버전은 언제 출시되나요?

A1. 현재는 안드로이드 전용이지만, Google은 곧 iOS 버전도 공개할 예정이라고 밝혔습니다. GitHub 저장소를 주기적으로 확인해보시기 바랍니다.

Q2. 모델 용량이 너무 큰 경우 어떻게 하나요?

A2. 일부 모델은 수백 MB 이상일 수 있으므로, Wi-Fi 환경에서 다운로드를 권장합니다. 모델 압축 버전도 선택 가능합니다.

Q3. 자체 학습 모델을 적용할 수 있나요?

A3. 예, TensorFlow Lite 또는 ONNX 포맷으로 변환하면 앱에 직접 추가할 수 있습니다.

Q4. 앱 내에서 모델 학습도 가능한가요?

A4. 현재는 모델 실행만 지원되며, 로컬 학습 기능은 향후 업데이트될 수 있습니다.

Q5. 모델이 잘 작동하지 않는 경우는 어떻게 하나요?

A5. 모델 포맷이 맞는지, 지원되는 연산 구조인지 확인 후 다시 업로드 해보세요. GitHub 이슈란에 문의해도 좋습니다.

Q6. 다국어 지원이 되나요?

A6. 대부분의 텍스트 모델은 영어 기반이지만, 한국어 지원 모델도 일부 존재하며 직접 추가할 수 있습니다.

Q7. 어느 정도 성능의 스마트폰이 필요한가요?

A7. 최소 4GB RAM, Snapdragon 700 시리즈 이상 또는 동급 칩셋이 권장됩니다.

Q8. 로컬에서 실행되면 배터리가 빨리 닳지 않나요?

A8. CPU/NPU 최적화를 통해 비교적 효율적인 전력 사용이 가능하지만, 장시간 사용 시 발열은 발생할 수 있습니다.